JoyGen简介

JoyGen 是由京东科技与香港大学合作开发的音频驱动3D说话人脸视频生成框架,一种新颖的两阶段框架,这个技术在于通过音频输入来驱动3D深度感知模型,提供精确的唇部与音频同步,以精确模拟说话者的唇部动作和面部表情,让生成的视频更逼真,主要应用于视频编辑和虚拟交互领域。

JoyGen使用了一个包含130小时高质量视频的中文说话人脸数据集进行训练。这个数据集与开放的HDTF(高分辨率深度图数据集)结合,支持中文和英文输入。

另外,JoyGen也考虑了音频的情绪特征,能够在生成的动画中自然地表现出人物的情感变化,例如微笑或皱眉等,非常的强。

JoyGen核心功能:

- 多语言支持:JoyGen能够处理中文和英文等多种语言的音频输入。

- 高质量视觉效果:通过细致的面部表情和唇部细节处理,生成的视频极其逼真。

- 精确唇部同步:通过音频特征分析和面部深度图技术,使视频中人物的唇部动作与音频内容完美匹配。

- 视频编辑优化:不仅生成新视频,还能对现有视频进行唇部运动的编辑,不需要从头开始又制作整个视频序列。

- 高效技术架构:采用单步UNet架构,可以让视频编辑流程更简单了。

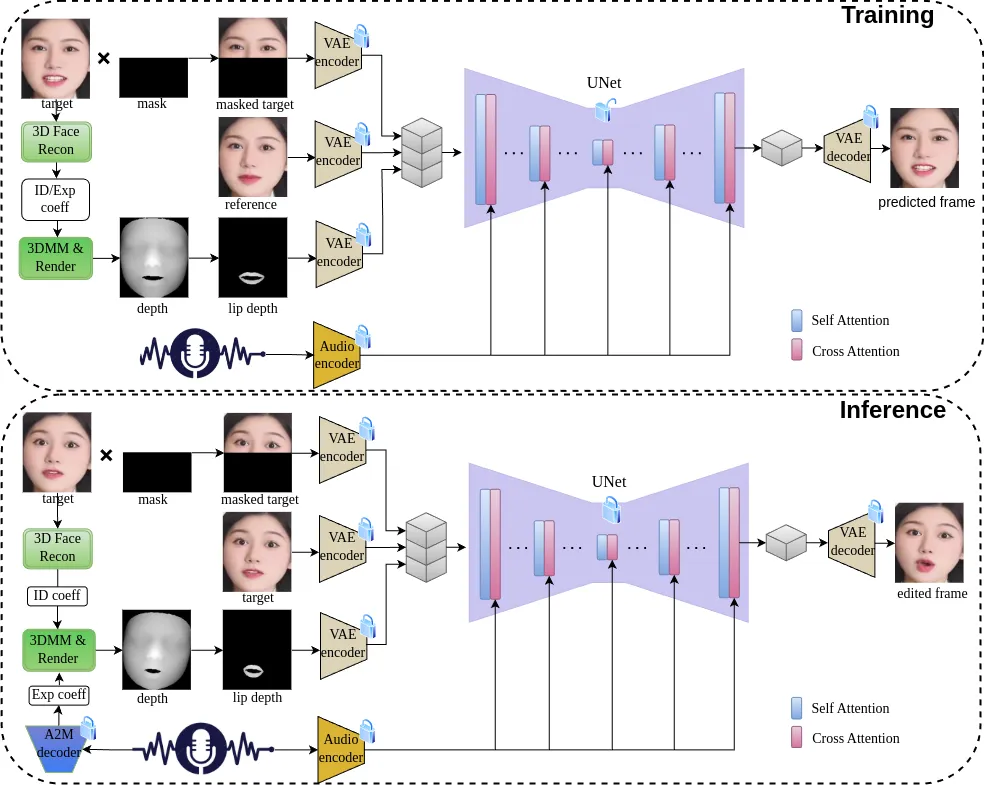

技术原理:

1. 音频驱动的唇部动作生成:

- 利用3D重建模型从面部图像提取身份特征,定义人物的独特面部结构。

- 通过音频到运动模型,将音频信号转换为控制唇部运动的表情系数。

- 结合身份和表情系数,使用可微渲染技术生成面部深度图,为后续视频合成准备。

2. 视觉外观合成:

- 采用单步UNet网络整合音频特征与深度图,直接生成包含精确唇部运动的视频帧。

- 引入跨注意力机制,确保唇部运动与音频信号高度一致,增强同步性。

- 通过优化过程(如L1损失函数)确保视频质量,兼顾像素级和潜在空间的准确性。

如何使用JoyGen:

- 环境搭建:用户需创建一个特定的conda环境,并安装必要的依赖包,包括Nvdiffrast等特定库。

- 预训练模型下载:获取JoyGen的预训练模型,包括3D模型、音频到运动模型等,这些资源通常在项目GitHub页面上提供。

- 运行推理:通过执行特定的脚本和参数,用户可以将音频文件转换为带有逼真唇部同步的3D说话人脸视频。

JoyGen应用:

- 虚拟会议:增强虚拟会议中的面部表达。

- 影视制作:制作电影和电视中的特效。

- 教育培训:用于制作生动的教育视频。

- ai助手:增加Ai助手在人与机器互动中的拟人程度。

JoyGen将复杂的人脸视频生成大大简化了,它在数字人内容创作、虚拟会议、娱乐等地方有非常大的作用。

GitHub:https://github.com/JOY-MM/JoyGen

数据统计

数据评估

关于JoyGen特别声明

本站土豆丝提供的JoyGen都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由土豆丝实际控制,在2025年8月15日 上午12:18收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,土豆丝不承担任何责任。

相关导航

Stunning.so,一款利用AI帮助用户快速轻松生成网站的工具。Stunning.so允许用户使用文本创建网站,还可以根据用户偏好进行定制。它无需编码或技术专业知识,从而简化了网站创建过程,使每个人都可以访问。

PydanticAI

PydanticAI,一个Pydantic 团队开发的Python代理框架,可以通过生成式AI轻松构建生产级应用程序。

AI看线(AI-Kline)

AI看线(AI-Kline),一个结合K线图,技术指标,财务数据,新闻数据的AI股票分析及预测框架,利用AI对股票市场进行深入分析。

CodeDesign.ai

CodeDesign.ai,一个人工智能驱动的网站构建器,CodeDesign.ai将帮助您通过简单的提示启动,托管和导出您的网站。

ReaddyAI

Readdy AI,一款AI网页UI设计和前端代码生成工具。它根据用户用自然语言描述的需求,快速生成专业网页界面设计稿和可用的前端代码,支持 React、Vue 等前端框架。

n8n

n8n,一款面向技术团队的强大工作流自动化软件,支持通过代码进行精准构建,也可通过拖放方式快速搭建工作流。它既可本地部署,也可云端托管,集成超500款应用。

YourWare

YourWare,一个专门用于上传和托管HTML或TSX文件的平台。并将其转换为托管在云端的网页或应用,让用户快速分享和展示他们的代码作品。

Doocs

Doocs,一款高度简洁的微信 Markdown 编辑器,支持 Markdown 语法、色盘取色、多图上传、一键下载文档、自定义 CSS 样式、一键重置等特性。

暂无评论...