Step-Audio简介

Step-Audio,作为业内首款产品级开源语音交互模型,具备根据场景需求生成多样化语音表达的能力,涵盖情绪、方言、语种、歌声以及个性化风格,且交互自然流畅。在汉语水平考试六级评测中,Step-Audio表现卓越,被誉为最懂中文的开源模型。此ai模型由阶跃星辰与吉利汽车集团联合研发,并于2025年2月18日正式开源。

Step-Audio功能特征:

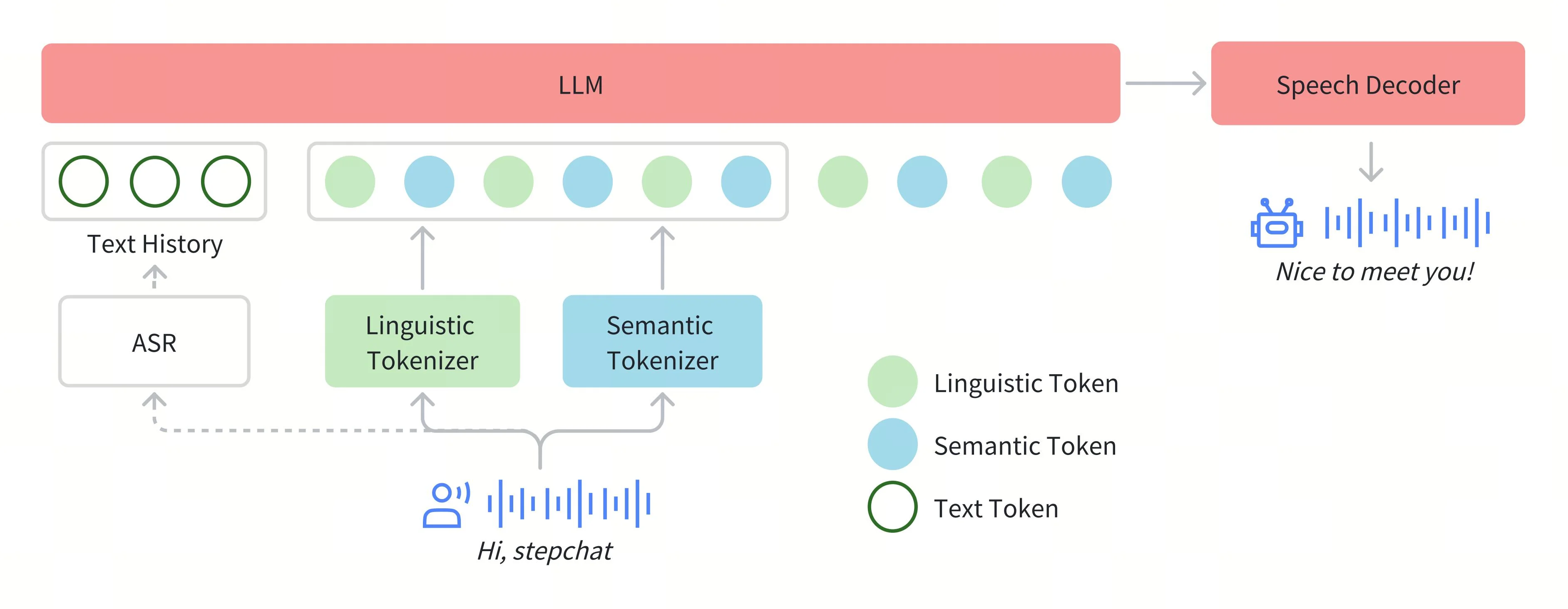

- 统一模型:基于130亿参数的多模态模型,实现语音理解与生成的统一,可同时处理语音识别、语义理解、对话、语音克隆、音频编辑与合成。

- 情感与风格多样化:根据需求生成不同情绪(生气/高兴/悲伤)、方言(粤语/四川话等)、语种、歌声(RAP/哼唱)及个性化风格的语音,精准调控情绪、方言、语种及歌声。

- 高质量对话:提供自然、高质量对话体验,交互自然流畅如真人交谈。

- 智能交互:具备逻辑推理、创作、指令控制、语言、角色扮演及文字游戏等高级交互特性。

Step-Audio应用场景:

- 智能客服:提供个性化、情绪化服务,提升用户体验。

- 有声阅读:生成有情感朗读,增强听书沉浸感。

- 音视频创作:自动生成视频配音或动画角色配音。

- 游戏NPC:为游戏角色提供自然流畅语音交互。

- 会议记录:实时转语音为文本,提供语音反馈。

- 教育辅助:个性化教学助手,调整教学风格语气。

Step-Audio技术特征:

- 高压缩比技术:采用Video-VAE等高效压缩技术优化数据处理。

- 双语处理能力:利用Hunyuan-CLIP和Step-LLM处理中英文提示。

- DIT架构与Video-DPO算法:优化复杂视频音频数据处理。

- 大规模数据集训练:构建大数据集,确保模型泛化与细节表现。

Step-Audio使用方法:

- 获取模型:访问跃问APP或Hugging Face等平台的Step-Audio开源版本。

- 技术报告:查阅arxiv.org或GitHub上的技术报告了解详情。

- API接口:通过API调用实现语音交互,遵循MIT开源协议。

- 集成开发:按官方文档或示例代码集成到应用中。

- 定制化训练:高级用户可微调模型以适应特定场景或提升性能。

Step-Audio获取方式

GitHub:https://github.com/stepfun-ai/Step-Audio

ModelScope:[点击访问]

技术报告:[点击访问]

支持PAI Model Gallery一键部署[点击访问]

数据统计

数据评估

关于Step-Audio特别声明

本站土豆丝提供的Step-Audio都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由土豆丝实际控制,在2025年8月15日 上午12:06收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,土豆丝不承担任何责任。

相关导航

Onlook,一款设计师的Cursor,支持对 React 网站进行可视化编辑并实时将修改写入代码,主打 “设计即编码”。

Copilot

Copilot,Copilot 是由 人工智能公司 和 GitHub 合作开发的一个基于人工智能的代码提示工具,它可以利用机器学习技术和大量训练数据生成高质量的代码。

文心快码Zulu

文心快码Zulu,百度文心快码推出的一款 AI 自动编程智能体,能够自主理解编码需求,精准拆解任务,并突破单文件限制,实现跨模块、跨目录的系统级代码生成。

imgcook图像大厨

imgcook图像大厨,imgcook是阿里巴巴前端委员会智能化小组的服务化的内外落地产品,通过智能化技术一键生成可维护的前端代码

Motionshop

Motionshop,AI角色动画工具,通过先进的视频处理和3D渲染技术,MotionShop能够高效地将视频中的某个角色替换为3D人物,同时不改变视频中的其他场景和人物。

LivePortrait

LivePortrait,利用AI技术将静态照片转换为视频,展现逼真的面部表情和动作。

AI神器集

AI神器集,一个专注于收集和分享AI产品及智能工具网站推荐排行榜的AI工具导航。用户可以在这里找到数千个AI产品,包括AI编程工具、AI知识库、AI写作、AI绘画设计等多种类别。

Trae国内版

Trae国内版,字节跳动推出的AI驱动的集成开发环境(IDE),专为国内开发者定制,界面全中文,支持豆包1.5-pro模型,可切换满血版DeepSeek模型,Trae国内版官网已上线 。

暂无评论...